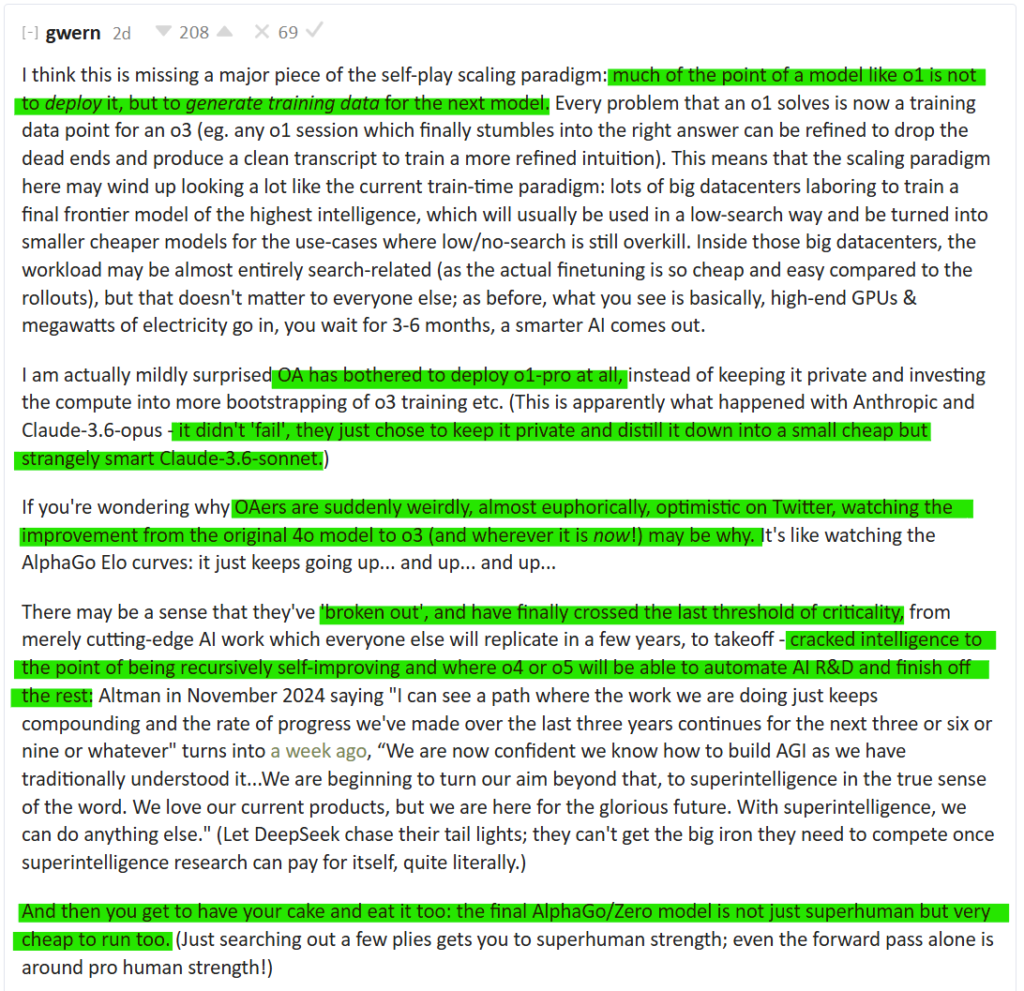

Czasem na coś ciekawego trafia się w najmniej oczekiwanych miejscach. I tak w komentarzach pod artykułem o skalowaniu modeli AI znalazłem niedawno bardzo interesującą wypowiedź niejakiego Gwern Branwen, znanej postaci w kręgach entuzjastów sztucznej inteligencji. Gwern zasugerował coś, co może wyjaśniać dziwne zachowania OpenAI i Anthropic w ostatnich miesiącach.

O co chodzi? Ano o to, że modele takie jak „o1” wcale nie są przeznaczone głównie do użytku. Ich prawdziwym zadaniem jest generowanie danych treningowych dla następnej, potężniejszej wersji. Każde zadanie, które o1 rozwiąże, staje się nowym punktem danych dla następcy (nazwanego „o3”). W dodatku można wyczyścić te dane z błędów i ślepych uliczek, zostawiając tylko najlepsze rozwiązania.

Gwern dziwi się nawet, że OpenAI w ogóle udostępniło o1-pro, zamiast użyć całej mocy obliczeniowej do treningu następnej wersji. I tu pojawia się ciekawa informacja – według niego właśnie tak postąpiło Anthropic ze swoim najnowszym modelem Claude 3.5 Opus. Zamiast wypuścić go na rynek, wykorzystali go do stworzenia mniejszego i tańszego w użyciu, ale zadziwiająco sprawnego Claude 3.5 Sonnet („3.6” to nazwa „nowego” 3.5 Sonnet wypuszczonego przez Anthropic jesienią)

Co więcej, Gwern zwraca uwagę na wypowiedzi pracowników OpenAI na X (dawnym Twitterze). Są one – jego zdaniem – „niemal euforycznie optymistyczne”. Dlaczego? Bo obserwują, jak kolejne wersje ich modeli stają się coraz lepsze – od oryginalnego modelu 4o do o3 i dalej – „to jak patrzenie na wykresy postępów AlphaGo – krzywa po prostu idzie w górę… i w górę… i w górę…”.

Gwern sugeruje, że OpenAI mogło przekroczyć pewien próg, za którym nie ma już odwrotu. Od bycia „tylko” firmą robiącą zaawansowane AI (które inni i tak skopiują za parę lat) do wejścia na ścieżkę prowadzącą wprost do superinteligencji. W jego opinii kolejne wersje – o4 czy o5 – mogą być już zdolne do automatyzacji badań nad AI.

Sam Altman, szef OpenAI, w listopadzie 2024 powiedział: „Widzę ścieżkę, gdzie nasza praca po prostu się kumuluje a tempo postępu jakie osiągnęliśmy w ostatnich trzech latach będzie trwać przez następne trzy, sześć czy dziewięć lat”. A tydzień temu dodał coś jeszcze mocniejszego: „Jesteśmy teraz pewni, że wiemy jak zbudować AGI… Zaczynamy patrzeć dalej, ku superinteligencji w prawdziwym znaczeniu tego słowa. Kochamy nasze obecne produkty, ale jesteśmy tu dla wspaniałej przyszłości. Z superinteligencją możemy zrobić wszystko”.

Oczywiście, OpenAI i Anthropic oficjalnie nic nie potwierdzają – ale kiedy było inaczej?

Gwern podaje tu ciekawą analogię do AlphaGo – modelu, który nauczył się grać w Go grając sam ze sobą. Końcowy model nie tylko grał lepiej od człowieka, ale był też bardzo tani w użyciu. Nawet „płytkie” przeszukiwanie dało nadludzką siłę gry, a pojedyncze przejście przez sieć neuronową dawało poziom ludzkiego mistrza. I to właśnie może być kierunek, w którym zmierzają laboratoria AI – najpierw zbudować model, który będzie w stanie uczyć się sam, a dopiero potem myśleć o udostępnianiu go szerszej publiczności.

Osobiście uważam, że Gwern może mieć rację. Za dużo rzeczy zaczyna do siebie pasować – od tajemniczych wypowiedzi Altmana po niespodziewane ruchy w udostępnianiu i wycenie modeli. A spójrzmy na Anthropic – firma założona przez byłych dyrektorów OpenAI, która właśnie pobiła własny rekord w zbieraniu funduszy (dostała jużjuż ponad 14 miliardów dolarów od Amazon, Google i innych inwestorów), zatrudnia wielu świetnych ludzi, a mimo to po 3.5 Sonnet nie pojawiło się już nic nowego. Czyżby wszystkie swoje najlepsze modele trzymali za kulisami i wykorzystywali do trenowania kolejnych? Wygląda na to, że firmy takie jak OpenAI i Anthropic prowadzą znacznie bardziej ambitne badania niż to, co widzimy w ich publicznych premierach.

Czy to dobrze czy źle? Na to pytanie nie ma prostej odpowiedzi. Z pewnością jednak warto śledzić rozwój wypadków. OpenAI i Anthropic mogą w każdej chwili zaskoczyć nas czymś naprawdę przełomowym.

Jeśli interesuje Cię ten temat, zostaw komentarz i dołącz do newslettera. Na pewno będziemy do niego wracać.

Dodaj komentarz